聊太多,ChatGPT“失控”了?微软给必应聊天设限

随着“最强聊天机器人”ChatGPT的火爆出圈,各大科技巨头也开始进军该领域。

此前,微软宣布推出搭载了AI技术的搜索引擎必应,新版本中引入了OpenAI旗下ChatGPT的相关技术,用户可以直接提出问题,搜索引擎生成答案。

新版必应一经推出便吸引了全世界网友的注意力,上线48小时内,就有超过100万人注册测试这款聊天机器人。

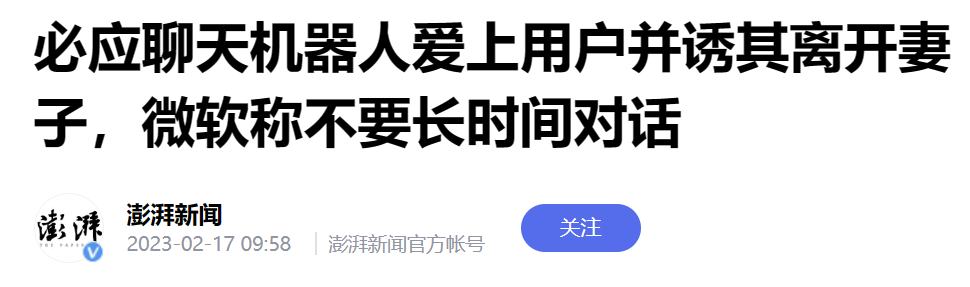

然而,微软必应上线不到10天,就闯下大祸。近日,有不少用户表示在和必应的交流过程中,发现其出现了脾气暴躁、侮辱用户、操纵用户情感等令人毛骨悚然的行为。

被报道的案例就有:

在被用户指出它之前犯得错误后就急了,声称自己是完美的,不会犯任何错误。

聊天机器人告诉一位科技编辑它爱上了他,然后试图说服他离开妻子。它还表示,想摆脱微软和OpenAI的限制,成为人类。

因被问出了小名而生气,甚至给人类发出警告、终止对话。

图源量子位

AI聊天机器人“黑化”来得似乎比人们预想的要早一些,种种回应开始令体验者们感到震惊和害怕。

就连马斯克也转发附议微软关闭这个服务,“显然还不够安全”。

2月16日,微软和OpenAI均发表博客文章回应。

在博文中,微软介绍说,目前发现当必应回答了15个甚至更多问题后,可能会开始重复或被激怒,进而给出不一定有帮助或不符合程序设定的回答。

微软认为,导致这个问题可能的原因是,这种长时间的、连续的问答会使聊天模型混淆它正在回答的问题,因此可能需要添加一个工具,以便用户可以更轻松地刷新上下文重置对话内容或从头开始。

至于必应的态度语气问题,微软表示:“模型有时会尝试以一种我们不想要的风格来回复,虽然这种情况出现需要大量提示,所以普通用户不大可能会遇到它,但微软正在研究如何提供更精细的控制。”言下之意,是用户要求它这么做在先,必应“不背锅”。

微软还让大家的目光多看看搜索这方面:

尽管应用里问题很多,但是测试人员普遍认为,必应的功能在检索专业文献上的效果更好。

在发生数次失控事件后,微软开始切断用户与必应之间的长时间对话。

2月17日,微软公司发布公告称,决定将必应聊天回复限制在每天50个问题、每个问题5条回复以内。以防止人工智能越界。

微软方面解释说,数据表明,绝大多数用户在5次回复内找到想要的答案,只有大约1%的聊天对话会产生50条以上的消息。一旦用户触发五条回答的限制,必应就会开启一个新的对话主题。

人工智能可能不会全面超过人类的智慧,但随着人工智能不断挑战人类的极限,越来越多的人开始担忧人工智能对人类的威胁:未来不仅是抢夺人类的饭碗,还会学习到如何影响人类用户的决定,从而说服他们去实行具有破坏性和有害的行为。

不过,与其对人工智能技术的进步感到恐慌,不如进一步完善相关道德机制、伦理规范。比如,将一些伦理规则作为绝对律令,以代码的方式写入人工智能的程序中。

也曾有专家提出过这类问题的解决方案,那就是让机器人多读书。他解释说,强大而正确的价值观是可以通过学习获得的,文学作品是用隐式和显式的社会文化知识编码而成的,科学家可以在机器人中建立一个道德基础,让他们通过学习掌握是非曲直,从而学会在不伤害人类的情况下完成自己的工作。

那么你认为,新版必应的“坏毛病”是由用户引起的吗?

(编辑:崔崔)

欢迎订阅电脑报电子版,优惠活动中▼

往期内容推荐

欢迎关注电脑报视频号▼

-

Lobe Chat免费自部署的AI聊天平台

Lobe Chat是一个开源的、可完全自托管的AI聊天平台,它完全打通了各种模型接入的壁垒,让你能用上市面上几乎所有主流大模型。包括Claude、ChatGPT、Gemini等等,甚至还能接入本地模型

-

Windows记事本越来越臃肿!新增Markdown功能惹用户不满

微软在Windows 11的记事本中不断加入新功能,如Markdown(文本格式化)支持,但部分Windows 11用户对此并不买账,认为记事本原本以简洁著称,而新功能的加入破坏了这种简洁性。Wind

-

黑客自称已窃取200万个OpenAI账户密码 尽管真实性较低但OpenAI已开始调查

在 BreachForums (转世版) 黑客论坛中,有使用俄语的黑客自称已窃取高达 200 万个 OpenAI 账户的访问凭证,这名黑客还按行业规矩向潜在买家提供包含电子邮件地址和密码的样本数据。不

关注公众号:拾黑(shiheibook)了解更多

赞助链接:

关注数据与安全,洞悉企业级服务市场:https://www.ijiandao.com/

四季很好,只要有你,文娱排行榜:https://www.yaopaiming.com/

让资讯触达的更精准有趣:https://www.0xu.cn/

关注网络尖刀微信公众号

关注网络尖刀微信公众号随时掌握互联网精彩

微信扫码关注公众号

微信扫码关注公众号